La revolución de la inteligencia artificial llegó para quedarse, pero no sin generar serias preocupaciones sobre su confiabilidad. Según informó Rosario3, un estudio del prestigioso diario The New York Times reveló que Gemini, la IA de Google, produce respuestas incorrectas en una de cada diez búsquedas, lo que representa millones de datos imprecisos circulando por la web.

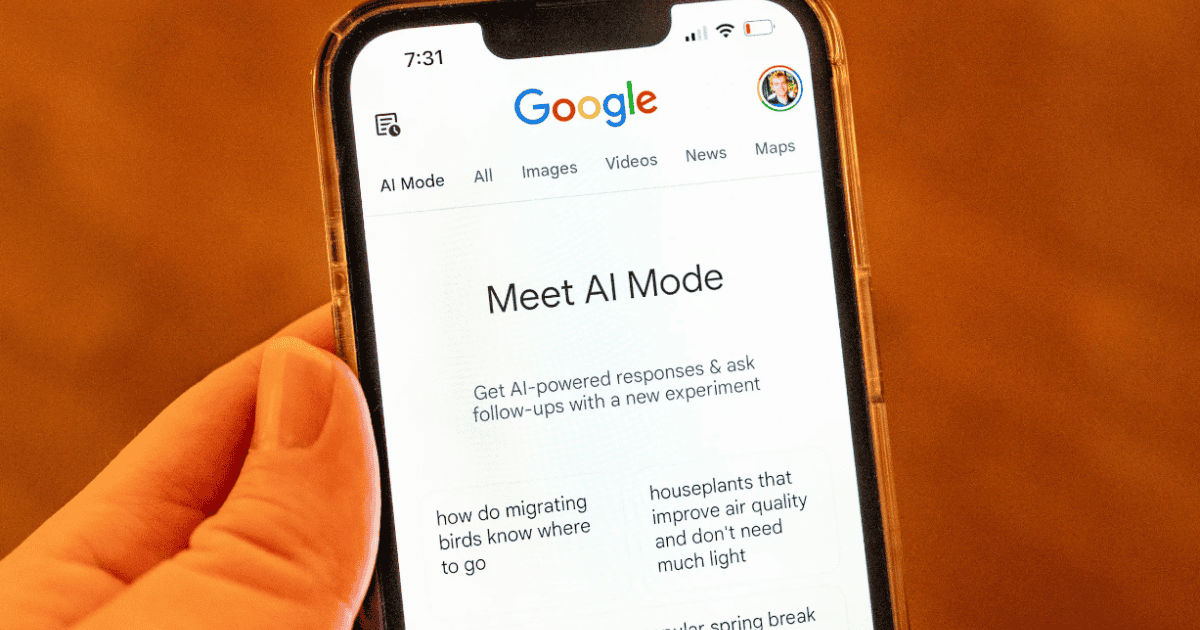

La investigación se centró en los AI Overviews, esa función que aparece en la parte superior de los resultados de Google y que promete resumir información sobre cualquier tema. Aunque la herramienta genera respuestas y enlaces que parecen correctos, la realidad es que no siempre son precisos, según confirmó este exhaustivo análisis.

El estudio, que se desarrolló durante todo el año pasado, analizó un total de 4.326 búsquedas para medir la efectividad de diferentes versiones de Gemini. Los resultados mostraron que la tasa de precisión inicial fue del 85 por ciento con Gemini 2.5, mientras que la versión más reciente, Gemini 3, logró mejorar hasta un 91 por ciento de aciertos.

"Nunca confíes de una fuente, siempre compará lo que obtienes con otra", advirtió el New York Times en sus conclusiones, una recomendación que cobra especial relevancia en una época donde millones de personas recurren diariamente a Google para resolver dudas sobre salud, finanzas, educación y otros temas cruciales para sus vidas.

Ante la difusión de estos resultados, Google reconoció algunas fallas en sus modelos y motores de búsqueda. "La IA puede cometer algunos errores", fue la escueta respuesta oficial de la compañía. Sin embargo, la empresa tecnológica también salió a defenderse, señalando que el análisis contenía información dudosa e incorrecta y que "este estudio tiene fallas importantes" porque "no refleja lo que la gente realmente busca en Google".

La polémica se intensifica cuando se considera que el estudio fue diseñado como una prueba de referencia por OpenAI, la creadora de ChatGPT y principal competidora de Google en el mercado de la inteligencia artificial. Esta situación plantea interrogantes sobre la objetividad del análisis y la guerra comercial que se libra entre las grandes tecnológicas por dominar el futuro de la IA.

Comentarios (12)

Deja tu comentario

Era obvio que esto iba a pasar. La IA está sobrevalorada, nada reemplaza el criterio humano y la verificación manual de datos.

91% de precisión no está mal para una tecnología tan nueva. El problema es que la gente la usa como si fuera infalible.

@TecnoRosario ¿En serio? Si yo busco información médica y me da mal, puede ser peligroso. 9 de cada 10 no alcanza para temas serios.

Google siempre fue una porquería para buscar cosas importantes. Ahora con la IA es peor, te da cualquier cosa y la gente se lo cree.

Como desarrollador te digo que estos estudios están sesgados. OpenAI hizo el test, obvio que van a hacer quedar mal a Google. Es marketing puro.

@Ingeniero_SW Puede ser, pero igual es preocupante. Mi hija usa Google para hacer la tarea y si le da mal información, ¿quién se hace cargo?

Yo dejé de usar Google hace rato. DuckDuckGo y fuentes directas, así no te comen el bocho con algoritmos truchos.

En el colegio les enseñamos a los chicos a verificar siempre las fuentes. La IA es una herramienta, no la verdad absoluta.

jajaja y después se quejan de las fake news. Google mismo te miente en la cara y nadie dice nada

4.326 búsquedas es una muestra chica para sacar conclusiones. Necesitarían al menos 10 veces más para que sea estadísticamente significativo.

@DataAnalyst_Rosario Puede ser, pero si mi viejo busca síntomas médicos y le dan cualquier cosa, no me importa el tamaño de la muestra.

Yo siempre desconfié de estas cosas. Prefiero llamar al médico o ir a la biblioteca de toda la vida.